1 nvidia-smi介绍

nvidia-sim简称NVSMI,提供监控GPU使用情况和更改GPU状态的功能,是一个跨平台工具,支持所有标准的NVIDIA驱动程序支持的Linux和WindowsServer 2008 R2 开始的64位系统。这个工具是N卡驱动附带的,只要装好驱动,就会有这个命令。

2 nvidia-smi常用命令介绍

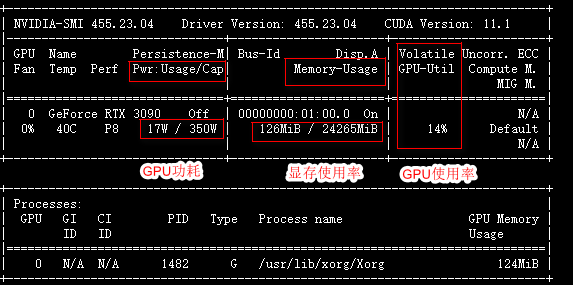

2.1 显示GPU当前状态:nvidia-smi

表格参数详解:

GPU:本机中的GPU编号(有多块显卡的时候,从0开始编号)图上GPU的编号是:0

Fan:风扇转速(0%-100%),N/A表示没有风扇

Name:GPU类型,图上GPU的类型是:Tesla T4

Temp:GPU的温度(GPU温度过高会导致GPU的频率下降)

Perf:GPU的性能状态,从P0(最大性能)到P12(最小性能),图上是:P0

Persistence-M:持续模式的状态,持续模式虽然耗能大,但是在新的GPU应用启动时花费的时间更少,图上显示的是:off

Pwr:Usager/Cap:能耗表示,Usage:用了多少,Cap总共多少

Bus-Id:GPU总线相关显示,domain:bus:device.function

Disp.A:Display Active ,表示GPU的显示是否初始化

Memory-Usage:显存使用率

Volatile GPU-Util:GPU使用率

Uncorr. ECC:关于ECC的东西,是否开启错误检查和纠正技术,0/disabled,1/enabled

Compute M:计算模式,0/DEFAULT,1/EXCLUSIVE_PROCESS,2/PROHIBITED

Processes:显示每个进程占用的显存使用率、进程号、占用的哪个GPU

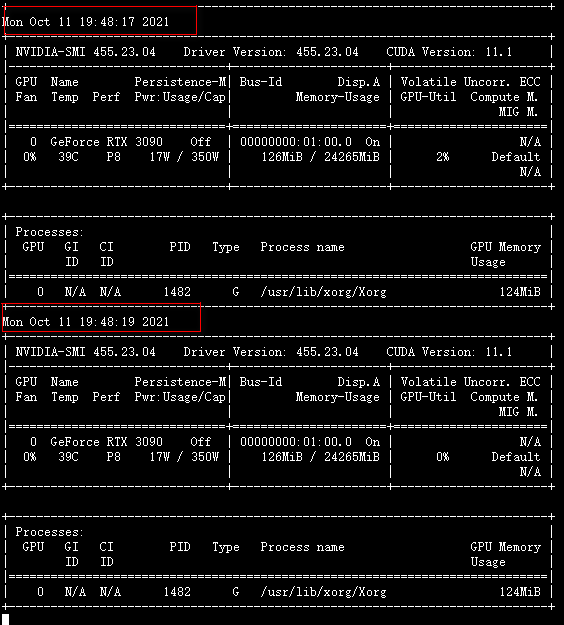

2.2 隔几秒刷新一下显存状态:nvidia-smi -l 秒数

隔两秒刷新一下GPU的状态:nvidia-smi -l 2

2.3 将监控结果写入文件,并且指定写入文件的监控字段

1 | nvidia-smi -l 1 --format=csv --filename=report.csv --query-gpu=timestamp,name,index,utilization.gpu,memory.total,memory.used,power.draw |

-l:隔多久记录一次,命令中写的是1

–format:结果记录文件格式是csv

–filename: 结果记录文件的名字

–query-gpu:记录哪些数据到csv文件

timestamp:时间戳

memory.total:显存大小

memory.total:显存使用了多少

utilization.gpu:GPU使用率

power.draw:显存功耗,对应Pwr:Usage

上面是显存监控中常用的几个命令,如果还有什么参数想了解,可以通过:

nvidia-smi -h 命令查看

如果想调整结果记录文件的字段,可以通过下面的命令查看对应的字段:

nvidia-smi –help-query-gpu

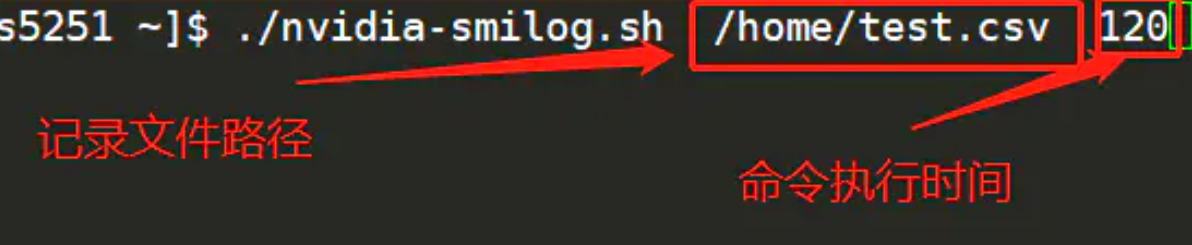

3 简易测试脚本

vidia-smi命令会实时记录gpu的情况,如果想让命令停止下来,需要手动执行ctrl-c,或者kill掉进程,为了便于使用,这里编写了一个shell脚本,输入:记录文件名、执行时间,执行命令即可

将下面的脚本复制到文本,然后保存,chmod 755 XXX.sh 修改脚本执行权限,执行即可

1 | #!/bin/bash** |